AI albo śmierć

Albo Europa przestanie widzieć w sztucznej inteligencji głównie zagrożenie, albo pozostanie w tyle za USA i Chinami. Albo polski gamedev zacznie otwarcie korzystać z AI, albo wyprzedzą nas inne kraje. Trzeciej drogi nie ma.

9 września media obiegł raport, który na zlecenie Komisji Europejskiej przygotował zespół kierowany przez Maria Draghiego, byłego prezesa Europejskiego Banku Centralnego i byłego premiera Włoch. Jego wnioski są minorowe: naszej gospodarce grozi „powolna agonia”, zaś Unia stoi przed „egzystencjalnym wyzwaniem”.

Jak podnosi Draghi, stolice Starego Kontynentu sromotnie przegrywają konkurencję z Pekinem i Waszyngtonem. Według analityków w 2024 r. kraje strefy Euro mogą liczyć na wzrost PKB na poziomie 0,9% – kilkukrotnie mniejszy nie tylko od Chin i USA, ale nawet uznawanej za międzynarodowego pariasa Rosji. (Pamiętajmy jednak o obecnych problemach z obliczaniem PKB tego państwa).

O co chodzi, przekładając to na kategorie makroekonomiczne? O to, że wzrost produktywności w Europie jest systematycznie wolniejszy niż w USA. Nie ma znaczenia, czy rozpatrujemy ostatnie kilka lat czy ostatnie ćwierćwiecze. pic.twitter.com/qC0gYt4lxd

— Analizy Pekao (@Pekao_Analizy) September 11, 2024

W ostatnich latach sytuacja jeszcze bardziej zmieniła się na niekorzyść Europy: produktywność w Europie systematycznie spada, w USA jest praktycznie na starym trendzie. pic.twitter.com/uaLoVyV6rq

— Analizy Pekao (@Pekao_Analizy) September 11, 2024

Szczególne zaległości mamy na polu innowacyjnych technologii. Według ekspertów Komisji Europejskiej aż 61% globalnych środków na rozwój AI trafia do firm amerykańskich, 17% do chińskich, a do europejskich – raptem 6%.

Taki rozkład to częściowo efekt fragmentaryzacji unijnego rynku, wysokich cen energii czy niechęci naszych funduszy do inwestowania w debiutantów. Częściowo zaś, kontynuuje Draghi, „niespójnych i restrykcyjnych przepisów”. Nie powinno więc dziwić, że zarząd co trzeciego europejskiego jednorożca – jak określa się start-upy, których wartość przekroczyła miliard dolarów – postanowił w ostatnich latach przenieść siedzibę gdzie indziej. I że zaledwie cztery z pięćdziesięciu najważniejszych światowych firm technologicznych to firmy europejskie.

„Pilnie potrzebujemy zwiększyć tempo”, słusznie diagnozuje Draghi, a receptą na zapóźnienia ma być wpompowywanie w nasze gospodarki – bagatela – 800 mld euro rocznie. Raport zaleca, by przeznaczyć te pieniądze na inwestycje w trzech obszarach, na pierwszym miejscu wskazując rozwój innowacji. Szczęśliwie, czytamy, jako że „świat stoi obecnie na progu kolejnej rewolucji cyfrowej, wywołanej przez rozprzestrzenianie się sztucznej inteligencji”, dla Unii otworzyło się okno możliwości.

Szkoda, że zamiast skorzystać z tej „drugiej szansy” – Europa dostrzega w niej głównie niebezpieczeństwo.

Unia reguluje, Francja protestuje

1 sierpnia weszło w życie unijne rozporządzenie AI Act, którego przepisy zaczną w pełni obowiązywać za dwa lata. To pierwsza na świecie regulacja mająca kompleksowo nakreślać ramy rozwoju, wdrażania i użytkowania sztucznej inteligencji. Choć jednak znajdziemy w niej rozwiązania potrzebne i słuszne (vide obowiązek oznaczania tzw. deepfake’ów, zakaz stosowania na terenie UE systemów punktacji społecznej czy narzędzi wykorzystywanych do śledzenia obywateli), przyjęcie AI Act budzi obawy o konkurencyjność europejskich podmiotów – alarmuje m.in. opiniotwórczy portal Politico .

Analitycy amerykańskiego think-tanku Centre for Data Innovation ostrzegają, że nowe prawo może zmniejszyć europejskie inwestycje w sztuczną inteligencję nawet o 20%, gdy tymczasem potrzebujemy wzrostów o kilkaset procent. TechMonitor podnosi, że tzw. koszty zgodności, a więc opłaty, które spółki będą musiały ponieść na dostosowanie swoich modeli do unijnych norm i standardów, mogą wynieść setki tysięcy euro. Co zrozumiałe, wydatek ten uderzy zwłaszcza w małe i średnie firmy.

Ale AI Act wzbudził nerwowość także wśród dużych spółek. Tyle że o ich interesy zadbały w porę kraje pochodzenia. Hamulcowym negocjacji przez długi czas była Francja, która obawiała się, że Unia spęta ręce paryskiemu Mistralowi, podobne wątpliwości wyrażały również Niemcy (gdzie rozwijany jest Aleph Alpha) i Włochy (iGenius). Ich lobbing okazał się skuteczny, w ostatecznej wersji dokumentu zmniejszono ograniczenia dotyczące mocy obliczeniowej modeli AI oraz poluzowano unijny nadzór. Największe państwa UE potrafią zadbać o swoje interesy, ale obawy o nadmierną biurokratyzację i zahamowanie innowacji pozostają na Starym Kontynencie żywe.

Luka regulacyjna i wykastrowany iOS

Pomysł na AI Act narodził się w zamierzchłym roku 2019, gdy Ursula von der Leyen po raz pierwszy kandydowała na stanowisko przewodniczącej Komisji Europejskiej. W programie Niemki znalazła się obietnica opracowania unijnych standardów dot. rozwoju sztucznej inteligencji… Sęk w tym, że ich uzgodnienie zajęło pięć lat (a kolejne dwa lata kraje członkowskie mają na wdrożenie zapisów rozporządzenia).

Co wydarzyło się w tzw. międzyczasie?

- OpenAI wprowadziło modele GPT-2, GPT-3, GPT-4, GPT-4o i GPT-o1.

- ChatGPT stał się standardem wykorzystywanym przez 180 mln użytkowników.

- Google wydało konkurencyjnego chatbota Bard (dziś: Gemini).

- DeepMind przedstawił światu AlphaFold, który pozwala przewidzieć strukturę białek, a w przyszłości pomoże w tworzeniu leków.

- Microsoft pożenił sztuczną inteligencję ze swoją wyszukiwarką Bing oraz udostępnił asystenta Copilot Pro, istotnie zwiększającego produktywność ludzkiej pracy.

- DALL-E, Midjourney i Stable Diffusion umożliwiły nam generowanie obrazów na podstawie tekstu (mało tego, podobne narzędzie znalazło się w Photoshopie).

- Zapowiedziano Sora, Veo i Stable Diffusion 3, które stworzą na bazie promptów filmy.

- Apple ogłosiło integrację AI z ekosystemem iPhone’ów, iPadów i Maców.

- Miliardy dolarów wpompowały we własne technologie Nvidia, Amazon, Tesla, Facebook i Huawei.

- …a także wiele, WIELE więcej!

Upowszechnienie modeli AI bywa porównywane do wynalezienia maszyny parowej, ale to nietrafiona analogia. Na naszych oczach rozgrywa się rewolucja, której kierunek trudno przewidzieć, a jeszcze trudniej: kontrolować. Unijna legislacja nie jest w stanie za tą zmianą nadążyć, już teraz AI Act boryka się z tzw. luką regulacyjną (regulatory gap), co dziwić nie powinno, gdyż – przypomnę – prace nad nim trwały pięć lat.

Źle, że europejskie prawo budzi kontrowersje. Fatalnie, że blokuje ono obywatelom wspólnoty dostęp do cennych narzędzi. Debiutujący właśnie iOS 18, najnowsza wersja systemu operacyjnego Apple’a, w krajach UE jest dostępny w bardzo okrojonej wersji, pozbawionej m.in. Apple Intelligence. Na innych szerokościach geograficznych Maki, iPhone’y i iPady zyskały masę ułatwiających codzienne życie (i pracę!) funkcjonalności, chociażby możliwość generowania filmów, redakcji tekstu, zarządzania powiadomieniami czy wykonywania transkrypcji.

Jak tłumaczył w rozmowie z Financial Times przedstawiciel Apple’a – Europejczycy muszą uzbroić się w cierpliwość „ze względu na niepewność regulacyjną” związaną z przepisami innego unijnego rozporządzenia, tzw. aktu o rynkach cyfrowych (Digital Markets Act).

Margrethe Vestager, unijna komisarka ds. konkurencji, przygląda się z kolei integracji z Windowsem funkcji Copilot oraz implementacji Google Gemini do nowych modeli Galaxy. Bruksela bada, czy porozumienia między big techami nie naruszają aby europejskich reguł sprawiedliwej konkurencji, wcale więc niewykluczone, że soft Microsoftu i smartfony Samsunga będą u nas dostępne w wybrakowanych wersjach.

Wielkie korporacje mogą sobie pozwolić na negocjacje z Komisją Europejską i ewentualne opłacenie nałożonych przez nią kar, ale w obszarze AI działają przecież także dziesiątki, a może i setki start-upów, które próbują zredefiniować nasz sposób korzystania z technologii. Zniechęcone nadmierną biurokratyzacją, często odpuszczają sobie one UE, ewentualnie odkładają wejście na nasze rynki na przyszłość.

Polska rewolucja z USA

Już teraz mnogość przepisów (i groźba wprowadzenia kolejnych ograniczeń) zniechęcają globalnych czempionów do inwestowania w Unii oraz udostępniania jej obywatelom innowacyjnych produktów. A nie zapominajmy, że również poszczególne kraje członkowskie podchodzą do sztucznej inteligencji z nieufnością.

Przykładem Włochy, które w kwietniu 2023 r. uniemożliwiły swoim obywatelom korzystanie z ChatuGPT, argumentując ten ruch obawami o naruszanie przepisów RODO (blokadę zdjęto po miesiącu). Hiszpanie powołali w ubiegłym roku Agencję Nadzoru Sztucznej Inteligencji, która ma uprawnienia inspekcyjne i może nakładać na niepokorne spółki wysokie kary. Polski wiceminister cyfryzacji Dariusz Standerski poinformował w maju o planach stworzenia rodzimego organu, który miałby pilnować etycznego wykorzystywania i rozwoju generatywnego AI.

Jeszcze za czasów PiS-u rząd uruchomił poświęcony sztucznej inteligencji portal, opublikował garść raportów (vide „AI w służbie lepszemu państwu”, „Generatywne AI w biznesie”), właśnie wznowiono też spotkania Grupy Roboczej ds. Sztucznej Inteligencji. O tym, jak Polska chce poprawić konkurencyjność naszych start-upów nie wiemy natomiast zbyt wiele. Sztuczna inteligencja jest ponadto właściwie nieobecna w programach rodzimych partii (z chlubnym wyjątkiem w postaci Nowej Lewicy); podczas kampanii politycy nie zawracali sobie głów propozycjami ulg podatkowych, grantów czy inwestycji w infrastrukturę cyfrową.

Śmiało wykorzystywali natomiast modele generatywne do produkcji spotów – posłowie Suwerennej Polski przedstawili dzięki nim złośliwą karykaturę Donalda Tuska, a PO zaprzęgło cyfrowego dublera Mateusza Morawieckiego do „odczytania” wiadomości upublicznionych w wyniku tzw. afery mailowej.

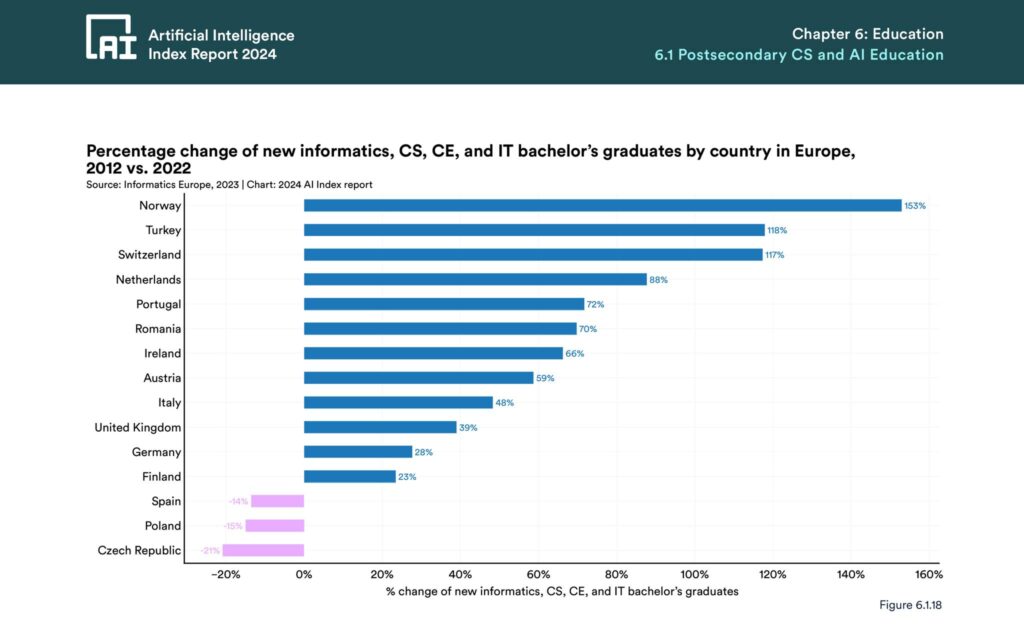

Jedno z największych wyzwań współczesnego świata jest dla naszej klasy politycznej niezrozumiałe. Jeśli już pojawia się ono w obszarze zainteresowań decydentów, to niemal wyłącznie w kontekście planowanych ograniczeń i etycznych wątpliwości. Tymczasem w wyścigu technologicznym zajmujemy dziś miejsce nawet nie tyle w ogonie stawki, ile na trybunach. Jeśli nic nie zmienimy, wkrótce zabraknie nam nie tylko rewolucyjnego know-how, ale i ludzi, którzy mogliby taką rewolucję przeprowadzić – alarmuje Uniwersytet Stanforda.

Marną pociechą jest, że nasz rodak, Piotr Dąbkowski, znalazł się w gronie „100 najbardziej wpływowych ludzi AI” magazynu „Time”. ElevenLabs, spółka, którą założył wraz z Mateuszem Staniszewskim, to dziś jeden z głównych rozgrywających w segmencie generowania mowy. Chociaż jednak kierują nią Polacy, jej siedziba mieści się w USA, a na rozwój firmy zrzuciły się amerykańskie fundusze.

Artyści protestują, korporacje generują

Sztuczna inteligencja stała się solą w oku wielu środowisk artystycznych. W ubiegłym roku miał miejsce najdłuższy strajk w historii Hollywoodu, którego uczestnicy głośno wyrażali obawy związane z jej rozwojem: scenarzyści domagali się, by modele językowe nie ingerowały w ich twórczość i nie uczyły się w oparciu o ich pracę, aktorzy żądali z kolei zabezpieczenia praw do swoich wizerunków. Wytwórnie wyszły naprzeciw ich oczekiwaniom, ale trudno mówić o końcu wojny twórców z generatywnym AI. Doszło co najwyżej do zawieszenia broni.

Kolejny front otwarli właśnie związani z gamedevem aktorzy głosowi i performerzy motion capture, którzy upominają się o podobną ochronę co ich koledzy z Fabryki Snów. Pod egidą związku zawodowego SAG-AFTRA przez półtora roku próbowali oni wynegocjować nowe standardy współpracy z m.in. z Epic Games, Electronic Arts i Activision. Ponieważ jednak rozmowy nie przyniosły rezultatu, od lipca trwa strajk, za którym opowiedziało się zresztą ponad 98% (!) członków związku. Dwa i pół tysiąca artystów nie pojawia się się od tego czasu w studiach nagraniowych i odmawia uczestnictwa w promocji gier ze swoim udziałem.

Effective July 26 at 12:01 a.m. Today’s vote to strike comes after more than a year and a half of negotiations without a deal.#VideoGameStrike #LevelUpTheContract #SagAftraStrong https://t.co/8InNdB05k8

— SAG-AFTRA (@sagaftra) July 25, 2024

Dodajmy, że alergiczne reakcje społeczności sprawiają, że niekiedy nie jest możliwa nawet sama dyskusja o wykorzystywaniu w sztuce modeli generatywnych. Przykładem Festiwal Komiksów i Gier w Łodzi, który na ostatniej prostej odwołał warsztaty „Jak używać AI”?

Całym sercem jestem za tym, by pracownicy branży byli godziwie wynagradzani, a ich twórczość podlegała należytej ochronie. Być może jednak gamedev, zmagający się właśnie z największą falą zwolnień w swojej historii (wg Game Industry Layoffs w ciągu półtora roku posady straciło globalnie 22 tys. osób!) nie powinien się na AI bezrefleksyjnie obrażać? Odwracanie wzroku może i pozwala nam poczuć moralną wyższość, z pewnością jednak zmniejsza naszą konkurencyjność. Postulaty ograniczenia rozwoju sztucznej inteligencji przypominają zaś pohukiwania średniowiecznych skrybów, domagających się wycofania maszyny drukarskiej Gutenberga.

Najwięksi wydawcy nic sobie zresztą z tego typu zarzutów nie robią. Zamiast tego przedstawiają kolejne pomysły na zrewolucjonizowanie produkcji gier.

- Duet Microsoft & Inworld AI zaanonsował narzędzie mające zautomatyzować tworzenie fabuł. Na bazie promptów podsunie ono scenarzystom „rozbudowane scenariusze, drzewka dialogowe i questy”.

Very proud to announce our partnership between @Xbox and @inworld_ai to bring the power of Generative AI and GPT to empower game developers in storytelling and character creation. We’re making tools for game makers on every platform to help creators express their vision! Stay… pic.twitter.com/GJ9SD6dXPC

— haiyan zhang (@haiyan) November 6, 2023

- Inworld AI próbuje ponadto usprawnić interakcje z postaciami niezależnymi. Odnosi już na tym polu pewne sukcesy, rzućcie no zresztą okiem na modyfikację Skyrima, w której zamiast wybierać z kilku opcji dialogowych – po prostu wpisujemy pytanie, a algorytm natychmiast generuje sensowną odpowiedź:

- Podobną technologię rozwija Ubisoft. Jego Ghostwriter ma – tłumaczą na blogu Francuzi – pisać pierwsze szkice wypowiedzi NPC-ów, które twórczo rozwiną później scenarzyści.

- Unity i Convai zaprezentowały natomiast demo technologiczne Project Neural Nexus, który „w locie” opracowuje zachowania i wypowiedzi bohaterów.

- Mało? W zeszłym roku firma pokazała Muse’a, który na podstawie komend tekstowych generuje tekstury, sprite’y, zachowania i animacje.

- Electronic Arts zapowiada zaprzęgnięcie AI do generowania modeli postaci, map i animacji, a także personalizowania komunikacji z graczem (co ma podnieść przychody z mikropłatności nawet o 50%). W zeszłym tygodniu jego CSO, Mihir Vaidya, pokazał demo technologii Imagination to Creation podczas spotkania z inwestorami.

- Z kolei Roblox ogłosił, że wykorzysta generatywne modele do tworzenia obiektów 3D na bazie dostarczanych przez graczy opisów.

- Chiński Tencent zaskoczył niedawno GameGen-O, modelem mającym generować gry wideo z otwartymi światami. Wykorzystuje on dane z ponad setki sandboxów, w tym GTA V, Assassin’s Creed: Valhalla, ale także polskich Wiedźmina 3 i Cyberpunka 2077.

Tencent presents GameGen-O

Open-world Video Game Generation

We introduce GameGen-O, the first diffusion transformer model tailored for the generation of open-world video games. This model facilitates high-quality, open-domain generation by simulating a wide array of game engine… pic.twitter.com/DlBt9iiLYZ

— AK (@_akhaliq) September 13, 2024

Tysiąc gier z elementami AI

Sztuczna inteligencja nie ma w branży dobrej prasy. Dowodem gniewna reakcja społeczności na artykuł WIRED, podług którego AI jest w jakiejś części odpowiedzialne za sprzedawany po 15 dolarów zestaw skinów do Call of Duty: Modern Warfare III. Ile w tym prawdy – nie do końca wiadomo, portal cytuje anonimowego artystę, dowodów jednak nie dostarcza. Z kolei wydawca (Activision) nie ustosunkował się do oskarżeń dziennikarzy.

A new report from WIRED claims that parts of the Yokai Wrath bundle released in Call of Duty: Modern Warfare III was made by A.I. software.

WIRED also claims Activision developers were approved to use generative AI programs earlier this year. pic.twitter.com/d4t1f071Yr

— CharlieIntel (@charlieINTEL) July 24, 2024

Sporo pomyj wylało się na autorów Duke Nukem 1+2 Remastered, gdy wykryto, że grafika promocyjna odświeżenia nie została narysowana przez człowieka (pod naporem krytyki zespół zdecydował się ją wycofać). Square Enix musiało przyznać, że niewielką część ilustracji shootera Foamstars wygenerowało Midjourney, zaś Embark Studios – że w przypadku głosów postaci The Finals wspomagali się narzędziem typu text-to-speech.

Ci ostatni mieli jednak odwagę bronić swojej decyzji. W rozmowie z Game Developer dyrektor marki Sven Grundberg prostolinijnie przyznał, że AI pozwala „tworzyć lepiej i szybciej oraz osiągnąć więcej mniejszym nakładem pracy”. Mało tego, doprecyzował, algorytmy pomogły jego zespołowi także przy projektowaniu poziomów czy przygotowywaniu animacji!

„Te nowe narzędzia nie znikną. Ważne, byśmy byli transparentni na temat tego, w jaki sposób je wykorzystujemy” – skwitował.

W styczniu Steam zaczął domagać się od studiów właśnie transparentności, Valve wprowadziło wówczas wymóg oznaczania gier, które wykorzystują treści generowane przez sztuczną inteligencję na stronie produktowej. W kwietniu jeden z jego pracowników przyznał, że na platformie pojawiło się już ponad tysiąc takich produkcji.

Branża się boi, ale stosuje GenAI

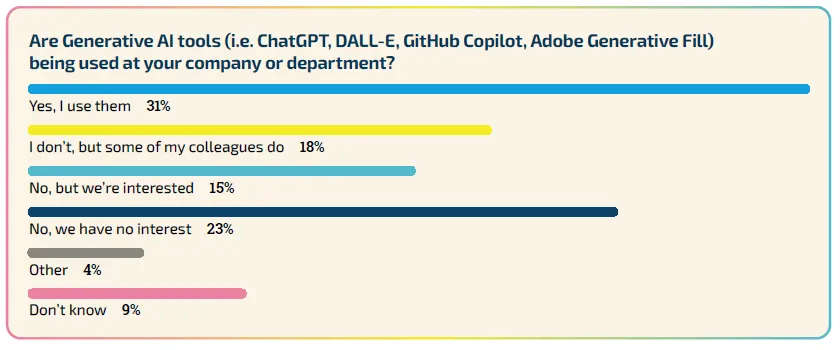

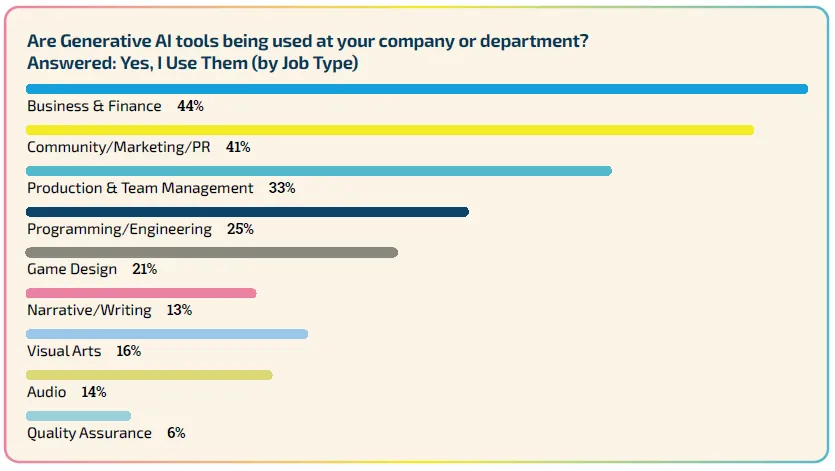

Podczas tegorocznego Game Developers Conference okazało się, że gamedev ma do generatywnego AI stosunek iście schizofreniczny: pracownicy powszechnie się go obawiają, ale zarazem masowo z niego korzystają. Podczas eventu upubliczniono wyniki ankiety, w której wzięło udział ponad 3 tys. twórców gier. Okazało się, że chociaż 84% respondentów patrzy na rozwój sztucznej inteligencji z niepokojem, połowa twierdzi, że ich pracodawca już teraz używa AI (a co trzeci developer sam się do tego przyznaje).

O generatywnych modelach sztucznej inteligencji mówimy głównie w kontekście strajków, prób uregulowania i wątpliwości etycznych. Być może jednak jesteśmy w stanie dzięki nim załatać przepaść między segmentami indie a AA, ułatwić debiutantom opracowywanie prototypów albo choć odrobinę odciążyć budżety powstających gier?

Szukanie oszczędności to dziś bowiem nie fanaberia marzących o kupnie Porsche prezesów, ale konieczność. Koszty produkcji blockbusterów rosną bowiem wykładniczo: Wiedźmin 3 (2016) pochłonął 306 mln zł, Cyberpunk 2077 (2021) – już 1,2 mld. Gwałtownie wzrastają także nakłady ponoszone na tytuły niezależne, tymczasem ich średnia dochodowość spada m.in. w związku z nadprodukcją. W 2023 na Steamie zadebiutowało 14,4 tys. gier – o dwa tysiące więcej niż rok wcześniej. Odbiorcy wymagają zaś tytułów coraz lepszych (a więc: droższych), nie chcąc płacić za nie więcej.

Rozmowa, nie zakaz

European Games Developer Federation twierdzi w swoim raporcie, że choć AI zmienia sposób tworzenia gier, treści generowane przez człowieka nadal pozostaną kluczowe. Organizacja zaleca stworzenie ram legislacyjnych, które zapewnią artystom sprawiedliwe wynagrodzenie oraz zabezpieczą ich prawa, jednocześnie jednak nie będą blokować innowacji. „UE musi ostrożnie zbalansować ochronę autorów ze swobodą działalności gospodarczej” – konstatują.

Na reaktywowanym PolskiGamedev.pl chcemy zainicjować rzetelną debatę na ten temat. Rację ma bowiem cytowany w tekście Sven Grundberg: „Te nowe narzędzia nie znikną”. Od tego, czy nauczymy się z nich korzystać, zależy być albo nie być naszej branży.